acshame

-

-

-

-

- 【vlog|程序员的我关掉了 AI,重新找回写代码的心流和快乐|在读《消失的多巴胺》,思考快感缺乏|保持思考|记录快乐的瞬间 😁-哔哩哔哩】 https://b23.tv/1j2e4L8

-

- 还记得我前天发的那个 Google 的能自己发现算法的 AlphaEvolve 吗?开源版本来了!

昨天 Google 刚刚发布了论文,今天开源实现就有了——OpenAplha_Evolve

感兴趣的同学可以自己部署试试,看看是不是真的能发明新的算法哈哈

地址:github.com/shyamsaktawat/OpenAlpha_Evolve

#ai创造营# https://mapp.api.weibo.cn/fx/33c0608573cf1f7bc081dc096a99c003.html -

-

- 字节也做了个 sandbox

https://github.com/bytedance/SandboxFusion - 如果不能对模型做RL, 还是想玩agent,那就尽量选最好的模型,否则确实是浪费时间,能做到力所能及的最好。要不然当玩具行,在高级任务上,真的没法用 https://mapp.api.weibo.cn/fx/635a4faa85ac1b8822fbd75b5a693e92.html

- 【重磅!LangChain发布开源无代码Agent构建平台】🤖

昨天LangChain悄悄放出大招——Open Agent Platform(OAP)开源平台!这个无需编程的智能体构建神器,让普通用户也能轻松打造高级定制化AI代理:

🛠️ 直连MCP工具库

📄 无缝对接LangConnect RAG

🤖 跨LangGraph智能体协同

更劲爆的是预 https://mapp.api.weibo.cn/fx/4592b973f0e28735ee71b0f31b8c9549.html -

- Netflix将于2026年推出生成式AI中插广告

Netflix宣布将于2026年在其流媒体服务中引入基于生成式AI技术的互动式中插广告和暂停广告,帮助其增加广告收入。

目前Netflix广告订阅层拥有9400万用户,占其总用户(3亿)的近三分之一,且新用户中有一半选择每月8美元的广告版而非起价18美元的无广告版。该公司计划在2025年使广告收入翻倍,并已于今年4月在美国推出自有广告平台。

Ars Technica

📮投稿 ☘️频道 🐶618红包 - 这篇文章讲了贝尔实验室成功的原因,核心领导者喜欢招募具有强烈好奇心和内在驱动力的“制造者和研究者”,并赋予他们极大的自由和自主权。公司文化鼓励研究人员之间的日常交流(talk to each other)、跨领域协作(cross-pollinate)和持续学习(continuous learning),营造了一个容忍失败、鼓励探索的环境。

https://1517.substack.com/p/why-bell-labs-worked

这让我想起一个著名的设计公司 IDEO, 与贝尔实验室有很多相同之处。曾经看过一个关于他们如何工作的纪录片 The Deep Dive, 非常受到启发,下面是我对这部片子的笔记的总结:

* 区分发明(提出想法)与设计(赋予形式并实现)。

* IDEO设计了许多日常产品(如软柄牙刷、苹果首款鼠标等),他们是“设计流程”的专家,而非特定领域专家。

* 他们的创新流程注重:

* 研究用户等“真正的专家”,获取第一手信息。

* 通过“深度潜水”式头脑风暴(鼓励狂野想法、延迟评判、在他人的想法上构建)快速产生大量想法。

* 强调团队判断而非个人权威或层级(“开明的试错胜过孤独天才的计划”)。

* 在时间限制下快速制作原型,并通过频繁试错来快速成功。

* 营造有趣环境,拥抱“聚焦的混沌”。

他们制定了一项叫 Deep Dive 的活动制度,类似于 Hackathon, 要在有限时间内分多个小组为同一个主题设计并推出解决方案,有这么一些准则:

- 一次只进行一场对话

- 专注于主题

- 鼓励大胆的想法

- 推迟判断

- 基于他人的想法进行构建

其中最后一点给我的印象最深,他们认为,当听到与自己不同的想法时,人们很难抑制住自己不去批判和否定的冲动,因此在一组人进行讨论时,会议主持者会关注一个人是否在本能地反对别人,如果这种情况发生,就会敲响铃铛,提醒他克制本能,重新思考。 - 这个博客的 about 页面说明了一种简单的生活哲学,很喜欢 “The game you're playing doesn't have any rules and there's no way to win” 这句话。如果人生是一场游戏,那么它既没有规则的限制,也没有所谓胜利的定义,所以应该尽己所能做想做的事情,并享受这个过程。

Wondering what to do with your life? Here’s what I suggest:

• First priority: Your physical health. (No health → no life.)

• Second priority: Reasonable financial security. (No food → no health.)

• Third priority: Good relationships with friends and family. (Depressed → no mental health.)

After that you can do whatever. The game you’re playing doesn’t have any rules and there’s no way to win.

https://dynomight.net/about/ -

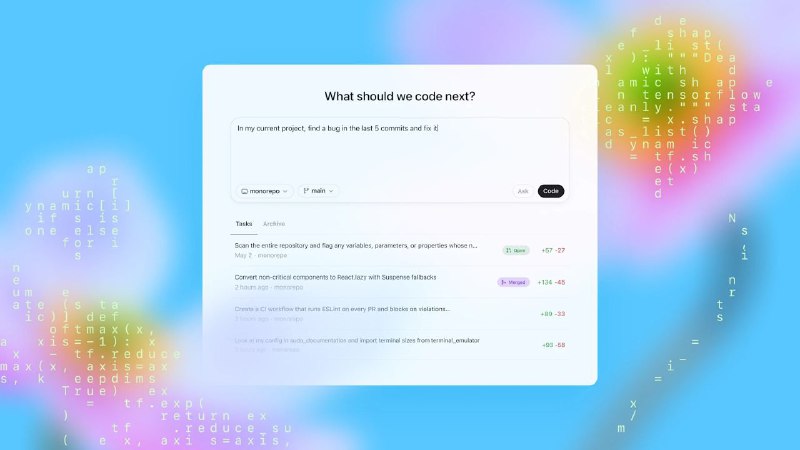

- Vibe Coding 要变天了?!OpenAI 发布代码 Agent:Codex

划重点:

1️⃣云:每个任务都在云沙盒环境中运行(预加指定代码库

2️⃣同时多任务

3️⃣底层模型为 codex-1:基于 o3 的 SWE(软件工程) 微调版本

4️⃣Pro 用户今天可用,Plus 要等

5️⃣API 定价:codex-mini-latest

输入:$1.5/1m tokens

输出:$6/1m tokens

6️⃣未来计划:支持实时协作和异步委托,将推出更具交互性和灵活性的 Agent 工作流程

细节:

7️⃣能力:Codex 可以读取和编辑文件,可运行包括测试工具、linters 和类型检查器等命令

8️⃣用时参考:一般任务需 1 min 30 s,可以实时监控 Codex 的进度

9️⃣完成结果:Codex 完成任务后会在其环境中提交更改,并通过引用终端日志和测试输出来提供其操作的可验证证据,可以追踪任务完成过程中的每个步骤

可以查看结果、请求进一步修订、提交 GitHub 拉取请求,或直接将更改集成到本地环境中

在产品中,可以配置 Codex 环境,使其尽可能与实际开发环境匹配

官文:https://openai.com/index/introducing-codex/ - #模型时代# 谷歌CEO皮查伊这段话含金量挺高的,由Gemini驱动的编码agent,优化了Gemini的训练,形成了一个数据飞轮。换句话说:AI训练AI。 https://mapp.api.weibo.cn/fx/cf933e68c840f4b12dc602cc2a22a6cf.html

- Minimax 最近发布的 Speech-02 音频模型,无论是打榜还是实际体验都很不错。今天技术报告也发布了。 arxiv.org/pdf/2505.07916

总的来说,该模型应用的 MiniMax-Speech 技术通过可学习的说话人编码器实现了高质量、高表现力、高相似度的真正零样本语音克隆,摆脱了对参考音频文本转录的依赖。结合Flow- https://mapp.api.weibo.cn/fx/3c45b8ff878b468b81c8cf93b082d05a.html